Grundlagen

Was KI in der Echtzeit-Physik bewegt

DeepMind steuert Plasma per RL-Agent, ECMWF fährt KI-Wettervorhersage produktiv, AlphaChip designt TPU-Chips: drei Fälle, wo KI gerade liefert.

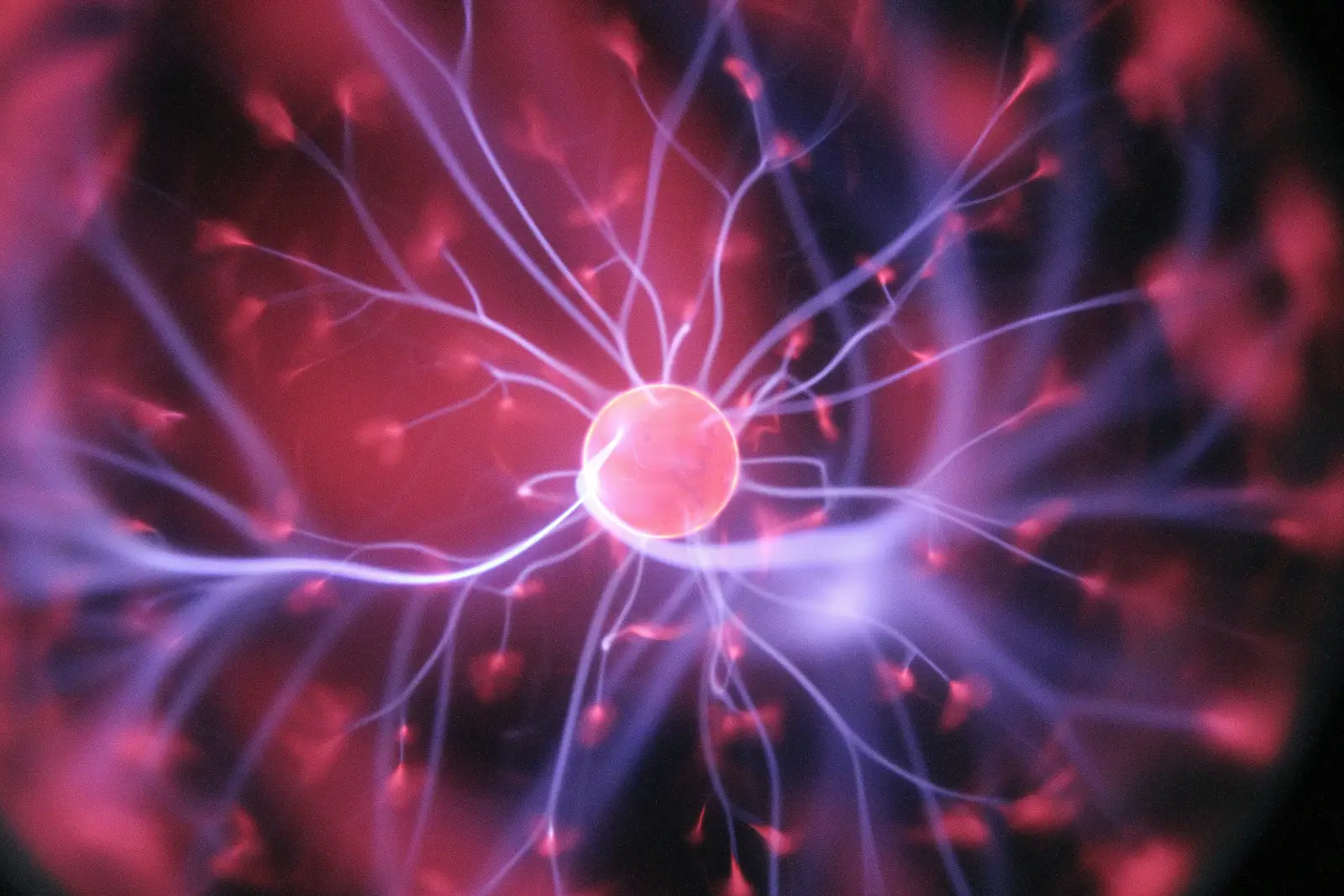

Stell dir vor, du stehst vor einem Behälter, in dem Gas auf 150 Millionen Grad erhitzt wird. Zwanzigmal heißer als das Zentrum der Sonne. Du kannst es nicht berühren, nicht anfassen, nicht mit einem physischen Werkzeug formen. Die einzige Möglichkeit, dieses Plasma in Form zu halten, sind präzise dosierte Magnetfelder aus Dutzenden von Spulen, die in Echtzeit auf jede Instabilität reagieren müssen. Jahrzehntelang war das ein Problem für spezialisierte Regelungstechniker mit Jahren Domain-Erfahrung. Seit 2022 macht das ein Reinforcement-Learning-Agent. Das ist die Art von Fortschritt, die in den nächsten drei Abschnitten wiederkehrt.

Plasma-Fusion: Ein RL-Agent am Steuer eines Tokamaks

Der TCV-Tokamak am Swiss Plasma Center der EPFL in Lausanne ist kein Kraftwerk. Er ist ein Forschungsreaktor, dessen Vorteil gerade seine Flexibilität ist: 19 unabhängig steuerbare Poloidalfeld-Spulen erlauben Plasmaformen, die an anderen Maschinen gar nicht erst versucht werden könnten.

Das Problem, das jahrzehntelang galt: Für jede neue Plasmaform braucht es eine eigene Regelungsstrategie. Physiker und Regelungstechniker setzen sich zusammen, verstehen das Modell, schreiben Steuerungsalgorithmen, testen sie im Experiment, korrigieren sie. Eine neue Konfiguration, eine neue Plasmaform, eine neue Stabilitätsbedingung: Wochen bis Monate Aufwand. Das Wissen ist implizit, schwer übertragbar, und jede neue Maschine, jeder neue Reaktor, fängt weitgehend von vorne an.

Was der RL-Agent ändert: Im Februar 2022 veröffentlichten DeepMind und das Swiss Plasma Center in Nature ein Reinforcement-Learning-System, das die 19 Spulen des TCV direkt steuert. Der Agent bekommt Sensordaten, sieht den Ist-Zustand des Plasmas, gibt Spannungswerte an die Spulen aus. Was er optimiert: wie nah die tatsächliche Plasmaform an der Zielform liegt. Das Modell wurde auf verschiedene Formen trainiert, darunter Kreise, D-Formen und eine Doppel-Null-Konfiguration. Es lernte nicht aus einer manuell programmierten Strategie, sondern entdeckte sie selbst. Neue Zielformen brauchen kein neues Regelungsprogramm, sondern ein neues Training.

2024 folgte ein Folgepaper in Fusion Engineering and Design, das den Ansatz praxistauglicher macht: stabileres Lernverhalten, Trainingszeiten um Faktor 3 reduziert, und eine Architektur, die besser mit realen Messrauschen umgeht.

Aktueller Stand, Oktober 2025: DeepMind und Commonwealth Fusion Systems (CFS) haben eine Forschungspartnerschaft bekannt gegeben. CFS baut SPARC, einen kompakten Tokamak mit Hochtemperatur-Supraleitern, der als erste Fusionsmaschine der Geschichte netto mehr Energie erzeugen soll als er zum Betrieb braucht, anvisiert für Ende 2026 bis Anfang 2027. Bestandteil der Zusammenarbeit ist TORAX, ein von DeepMind entwickelter open-source Plasma-Simulator in JAX. TORAX läuft auf CPUs und GPUs und lässt sich mit RL oder evolutionären Such-Algorithmen kombinieren. CFS kann damit Millionen virtueller Experimente simulieren, bevor SPARC überhaupt eingeschaltet wird.

Grenzen: TCV ist ein Forschungsreaktor mit wenigen Megawatt Heizleistung. Der RL-Agent löst das Regelungsproblem, nicht das Energieproblem: wie extrahiere ich Wärme, wie züchte ich Tritium nach, wie halte ich die Wand am Leben. Diese Fragen sind offen und unabhängig davon, wie gut das Plasma stabil gehalten wird. Der Weg von "Plasma ist stabil" zu "kommerzielle Kilowattstunde aus Fusion" ist noch Jahrzehnte Ingenieursarbeit auf Gebieten, bei denen KI bisher keine Rolle spielt.

Wettervorhersage: GraphCast, GenCast und das Ende der Supercomputer-Hegemonie

Das European Centre for Medium-Range Weather Forecasts (ECMWF) in Reading gilt seit Jahrzehnten als das beste Wettervorhersagezentrum der Welt. Sein Integrated Forecasting System (IFS) ist eine physikalische Simulation der Atmosphäre auf einem globalen Gitter, berechnet auf Tausenden von CPU-Kernen über mehrere Stunden. Das Ensemble-Modell (ENS) rechnet 50 leicht variierte Läufe parallel, um Unsicherheiten zu quantifizieren: noch mehr Rechenaufwand, noch mehr Infrastruktur.

Das Problem, das jahrzehntelang galt: Numerische Wettermodelle basieren auf partiellen Differentialgleichungen, Navier-Stokes-Dynamik, Strahlungsübertragung, Wolkenmikrophysik. Sie sind physikalisch konsistent und gut verstanden, aber sie brauchen Supercomputer. Für Länder ohne diese Infrastruktur bedeutet das: keine eigenen Hochleistungs-Forecasts. Und bei einer 7-Tage-Vorhersage nehmen die Fehler ohnehin stark zu, weil das chaotische System die Vorhersagbarkeit begrenzt.

Was KI ändert: Im November 2023 veröffentlichte DeepMind GraphCast, ein Graph-Neural-Network-Modell, trainiert auf 39 Jahren ECMWF-Reanalysedaten (ERA5). GraphCast erzeugt eine 10-Tage-Globalvorhersage auf einer einzigen TPU in unter einer Minute. Ein direkter Vergleich auf 1.380 Forecast-Targets zeigt: GraphCast übertrifft das ECMWF HRES auf 90% dieser Targets. Besonders bei Extremereignissen war der Vorsprung deutlich, laut DeepMind-Auswertung wurden Hurrikan-Tracks bis zu sechs Tage im Voraus präziser vorhergesagt als mit dem klassischen Modell.

Im Dezember 2024 erschien GenCast in Nature, ein diffusionsbasiertes probabilistisches Modell, das Ensembles erzeugt. 15-Tage-Forecast, 50-Mitglieder-Ensemble, 0,25° Auflösung, in 8 Minuten. Das ECMWF ENS wird auf 97,2% der 1.320 geprüften Targets übertroffen.

Wo es heute operativ läuft: ECMWF hat reagiert, und zwar nicht nur mit Forschungsbetrieb. Am 25. Februar 2025 ging AIFS (Artificial Intelligence Forecasting System), ECMWFs eigenes GNN-Modell in Anlehnung an die GraphCast-Architektur, als offizielles operatives System in Betrieb, gleichrangig neben dem traditionellen IFS. Am 1. Juli 2025 folgte AIFS ENS, die Ensemble-Version. AIFS läuft nach ECMWF-Angaben 10-mal schneller als das physikalische IFS und benötigt rund 1.000-mal weniger Energie. Bei tropischen Zyklonen verbesserte sich die Track-Prognose um bis zu 20%.

Grenzen: KI-Wettermodelle werden schlechter bei Ereignissen, die im Trainingsdatensatz selten vorkommen: ungewöhnliche Blocking-Situationen, Sturm-Tracks abseits historischer Muster, Extremereignisse an der Grenze des Beobachtungsraums. Sie können physikalisch inkonsistente Felder produzieren, also etwas, das die Atmosphäre so nicht kann. ECMWF hat physikalische Konsistenz-Constraints in AIFS eingebaut, die in GraphCast fehlen. Die Beobachtungsinfrastruktur (Satelliten, Radiosonden, Bodenstationen) bleibt unersetzlich: ohne gute Eingangsdaten verbessert kein Modell die Ausgabe.

AlphaChip: Wochen werden Stunden

Ein moderner System-on-Chip enthält Hunderte von Makro-Blöcken: SRAM-Bänke, Recheneinheiten, Analog-IPs, I/O-Controller. Alle müssen auf einem Die platziert werden, so dass Leitungslängen kurz sind, Wärme gut verteilt wird und Timing-Anforderungen eingehalten werden. Das ist das Floorplanning-Problem, und es ist seit den 1970ern bekannt: NP-schwer, exponentiell im Suchraum, von keiner Heuristik wirklich gelöst.

Das Problem, das jahrzehntelang galt: Erfahrene Physical-Design-Engineers arbeiteten Wochen bis Monate an einem einzigen Floorplan. Ihr Wissen war implizit: wo man ein SRAM platziert, um Routing-Staus zu vermeiden, wie man Blöcke gruppiert, damit die Taktverteilung passt. EDA-Tools wie Synopsys oder Cadence geben Orientierung, aber die finale Qualität hängt an menschlicher Erfahrung. Ein schlechtes Placement kann einen Chip-Takt um mehrere hundert Megahertz senken, was bei KI-Chips direkt in Trainingszeit und Kosten übersetzt.

Was AlphaChip ändert: Google Brain (heute Google DeepMind) veröffentlichte 2021 das Chip-Placement-Paper in Nature, das Floorplanning als Reinforcement-Learning-Problem formuliert: Ein Agent lernt, Makro-Blöcke auf einem simulierten Die zu platzieren, mit einer Belohnungsfunktion über Wirelength, Congestion und Timing. Das Modell wurde auf Tausenden historischer Chip-Designs vortrainiert und generiert neue Layouts in Stunden. Laut DeepMind-Blog wurden damit TPU v4, TPU v5 und der Trillium (6. Generation) designed. Mit jeder Generation liefert AlphaChip einen größeren Anteil des gesamten Floorplans, und die Ergebnisse verbessern sich.

Laut DeepMind-Blog gab MediaTek im September 2024 bekannt, AlphaChip für seine Dimensity-5G-SoCs einzusetzen. Diese Chips stecken in Hunderten Millionen Smartphones. Außerdem nutzt Google AlphaChip für den Axion Processor, die eigene Arm-basierte Data-Center-CPU. Die Modell-Weights sind open-source verfügbar.

Grenzen: AlphaChip löst Placement, nicht die gesamte EDA-Kette. Routing, Signalintegrität, Power-Grid-Analyse, Timing-Closure: das kommt alles danach und ist weiterhin menschliche und werkzeugbasierte Arbeit. Für Teams außerhalb von Google-Skala ist die Adoption nicht trivial, das Modell braucht historische Chip-Daten zum Feinabstimmen, die kleinere Halbleiter-Teams oft nicht haben. Die wissenschaftliche Kontroverse um das ursprüngliche Nature-Paper (eine externe Forschungsgruppe stellte die Ergebnisse infrage) hat Nature nach eigener Untersuchung zugunsten von Google abgeschlossen.

Was das im Kundengespräch ändert

Die drei Fälle klingen weit weg vom Alltag eines IT-Beratungsprojekts. Aber alle drei haben konkrete Kunden-Kontexte, in denen sie als Gesprächsanker funktionieren.

Bei einem Kunden aus Energie-Forschung, Hochleistungsregelungstechnik oder industrieller Physik: "DeepMind und Commonwealth Fusion Systems haben im Oktober 2025 angekündigt, den SPARC-Reaktor per RL-Agenten zu steuern, mit Millionen virtueller Experimente in Simulation, bevor die Maschine überhaupt eingeschaltet wird. Der Simulator ist open-source. Wenn eure Regelungsprobleme physikalisch komplex und schwer zu modellieren sind, ist das eine Architektur, die ihr kennen solltet."

Bei einem Kunden aus Logistik, Versicherung oder Landwirtschaft, der Wetterdaten in Anwendungen einbindet: "ECMWF hat im Februar 2025 sein KI-Vorhersagemodell als offizielles operatives System in Betrieb genommen. Die Daten, gegen die eure Anwendungen heute API-Calls machen, kommen bald aus einem KI-Modell mit deutlich weniger Rechenaufwand und vergleichbarer oder besserer Genauigkeit. Ob das eure Ernteschätzung, Routingoptimierung oder Katastrophenschutz-Modelle verbessert, hängt davon ab, bei welchen Wetterereignissen die Verbesserung liegt, aber es lohnt sich, das jetzt zu prüfen."

Bei einem Kunden aus der Halbleiter-Industrie oder einem Zulieferer mit Chip-Designanteil: "MediaTek setzt AlphaChip seit 2024 produktiv für seine Dimensity-5G-SoCs ein, das sind Chips in Hunderten Millionen Smartphones. Die Modell-Weights sind open-source. Das ist kein Forschungsprojekt mehr, sondern ein Tool, das ein direkter Wettbewerber schon verwendet."

Bildnachweise

- Plasma-Kugel: Foto von Hal Gatewood auf Unsplash

- Gewitterwolken: Foto von Олег Мороз auf Unsplash

- Platine: Foto von Umberto auf Unsplash

Quellen9

- DeepMind - Accelerating fusion science through learned plasma controldeepmind.google

- Nature - Magnetic control of tokamak plasmas through deep reinforcement learning (2022)nature.com

- ScienceDirect - Towards practical reinforcement learning for tokamak magnetic control (2024)sciencedirect.com

- DeepMind - Bringing AI to the next generation of fusion energy (CFS-Partnerschaft, 2025)deepmind.google

- DeepMind - GraphCast: AI model for faster and more accurate global weather forecastingdeepmind.google

- Nature - Probabilistic weather forecasting with machine learning (GenCast, 2024)nature.com

- ECMWF - AI forecasts become operational (Februar 2025)ecmwf.int

- ECMWF - Ensemble AI forecasts become operational (Juli 2025)ecmwf.int

- DeepMind - How AlphaChip transformed computer chip designdeepmind.google